ElevenLabs UI busca simplificar eso con una colección open source de componentes React para experiencias de voz, agentes conversacionales y audio en tiempo real. Está basado en shadcn/ui, por lo que los componentes se integran en tu propio código y pueden modificarse libremente.

La propuesta es práctica: en vez de depender de una librería cerrada, incorporas bloques reutilizables a tu proyecto. Para equipos que trabajan con React, Next.js y Tailwind, la adopción resulta natural. No exige reaprender medio frontend para agregar un micrófono funcional.

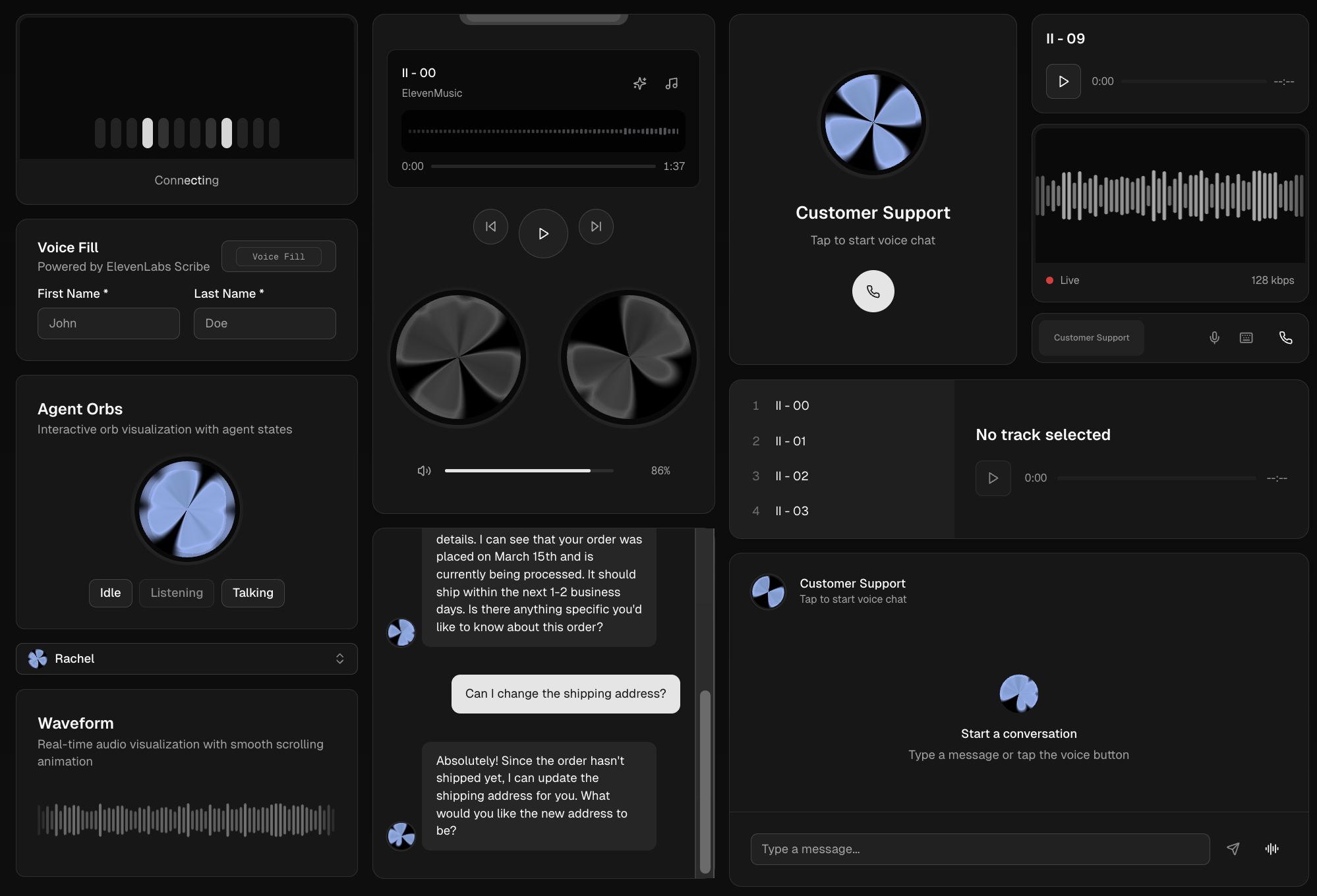

Entre los componentes disponibles destacan Conversation Bar para chats de voz con WebRTC, Speech Input para transcripción, Voice Picker para seleccionar voces, Waveform para visualización de audio y elementos de mensajería para interfaces conversacionales. En otras palabras, cubre la parte tediosa de construir productos multimodales.

Para desarrolladores, el valor real está en los casos de uso: soporte automatizado, copilotos internos, asistentes manos libres, herramientas de accesibilidad, onboarding conversacional o voice commerce. En lugar de invertir semanas resolviendo UX de audio y sincronización, puedes concentrarte en lógica de negocio.

También deja clara la ambición de ElevenLabs: pasar de proveedor de voces a plataforma completa para productos conversacionales. Eso trae ventajas de integración, aunque conviene mantener arquitectura desacoplada para no quedar demasiado atado a un solo proveedor.

En resumen, ElevenLabs UI no promete cambiar el mundo. Solo ahorrar tiempo a quienes necesitan lanzar experiencias con voz sin reinventar cada botón. Y eso ya es bastante raro.